Neural Computers:当神经网络变成计算机本身

Neural Computers:当神经网络变成计算机本身

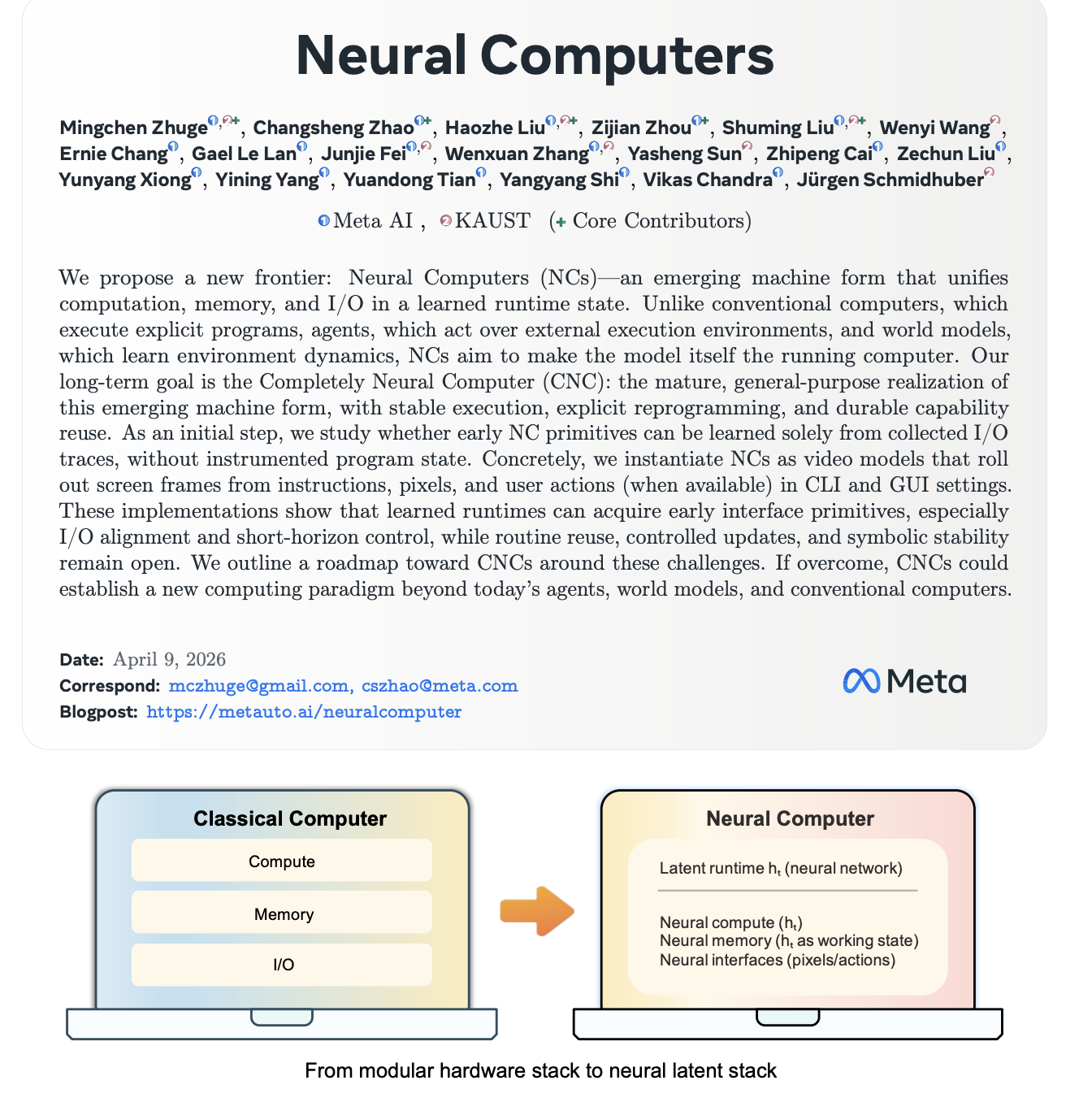

Meta AI 最新论文提出了一种全新的机器形态——神经计算机(Neural Computer)。它的目标是让一组神经网络权重直接充当一台运行中的计算机,将计算、存储、输入输出全部统一到一个学习到的潜在运行时状态中。

一句话总结

传统计算机靠硬件执行程序,AI 智能体靠模型操控现有计算机,而神经计算机的野心是——让模型本身就是那台计算机。

这篇论文在讲什么

2026 年 4 月 9 日,Meta AI 联合 KAUST 发表了一篇名为「Neural Computers」的论文。它提出了一个简单但激进的问题:

一组权重能不能直接当计算机用?

我们今天使用 AI 的方式,无论是 ChatGPT 聊天、Claude 写代码,还是各种 AI Agent 自动操作浏览器,底层都有一个共同特征:AI 模型在"使用"一台现有的计算机。Agent 通过键盘鼠标操控桌面,代码助手通过 API 调用编译器和终端,世界模型预测环境变化——但执行和存储状态的工作,始终在模型外部。

Neural Computer(以下简称 NC)想打破这个边界。它的核心主张是:把计算、存储和 I/O 全部装进一个神经网络的潜在状态里,让模型自身成为那台正在运行的机器。

和现有系统有什么区别

这可能是理解 NC 最关键的一步。我们把四类系统对比一下:

传统计算机——围绕显式程序组织,通过硬件执行指令,真理来源是代码和机器状态。

AI 智能体——围绕任务组织,通过外部环境(浏览器、终端、IDE)完成工作,模型是"操作员",计算机是"工具"。

世界模型——围绕环境动态组织,预测给定动作后环境会怎样变化,但它本身并不执行任何程序。

神经计算机——围绕运行时状态组织,所有能力都积累在一个学习到的系统内部,模型本身就承担了执行、存储和接口的角色。

换个更直观的说法:Agent 像是一个聪明的用户在操作电脑,而 NC 想成为电脑本身。

它是怎么实现的

当前阶段,论文作者选择用视频生成模型作为 NC 的原型载体。道理很直接:视频模型是目前最接近"端到端学习运行时状态"的现有技术——它能同时建模像素、动态变化和动作条件控制。

具体来说,他们在 Wan2.1(一个先进的视频生成模型)基础上,构建了两个原型:

NC_CLIGen:终端界面的神经计算机

你给它一段文字提示(比如"打开 Python,计算 1 到 10 的平方"),再给一个初始终端画面,它就会像真实终端一样,逐帧生成后续屏幕画面。

训练数据来自两个来源:

- 约 82 万条公开的终端录屏(asciinema 格式),涵盖各种真实的命令行操作

- 用 vhs 工具录制的确定性脚本(约 25 万个),在 Docker 环境中执行,画面更干净一致

NC_GUIWorld:桌面界面的神经计算机

这个更激进——你给它鼠标和键盘输入,它生成对应的桌面 GUI 画面变化。它能模拟 Ubuntu 桌面环境中 Firefox、GIMP、VS Code、VLC 等应用的交互过程。

数据来自 Ubuntu XFCE4 桌面的录屏,其中一部分是随机探索,另一部分是 Claude CUA(计算机使用 Agent)执行的有目标的操作轨迹。

关键发现

论文做了大量实验,这里提炼几个最重要的结论:

1. 它确实能"运行"

在 13px 的标准终端字体下,NC 生成的终端画面视觉保真度很高(PSNR 40.77 dB,SSIM 0.989)。文字清晰可读,颜色和格式都能正确渲染。OCR 字符准确率在训练后持续提升,达到 0.54。这些不再是"看起来像终端"的模糊图片,而是字符级别可用的终端渲染。

2. 数据质量远比数据数量重要

在 GUI 实验中,仅 110 小时 Claude 执行的有目标操作数据,就全面碾压了 1400 小时的随机桌面探索数据。高质量的目标导向交互产生清晰的动作-响应对,而随机操作充满噪声和抖动。

这对 NC 的未来路线有重要启示:精心策划的交互数据,比海量的被动录屏有价值得多。

3. 精确的鼠标控制需要显式视觉监督

仅靠坐标信息只能达到 8.7% 的光标准确率。当引入 SVG 光标遮罩和参考帧后,准确率飙升至 98.7%。神经计算机更擅长把光标当作一个视觉对象来学习,而非仅仅依赖抽象坐标。

4. 符号计算是最大的短板

这是论文中最值得关注的发现之一。研究者用简单的算术题测试 NC 的符号推理能力,结果:

| 模型 | 算术准确率 |

|---|---|

| Wan2.1(基座) | 0% |

| NC_CLIGen | 4% |

| Veo 3.1 | 2% |

| Sora2 | 71% |

这些是人类能瞬间解答的简单数学运算,但几乎所有视频模型都无法做到。Sora2 是个例外,可能受益于 RL 训练或更强的系统级条件控制。

有趣的是,通过"重新提示"(在训练标题中直接包含答案),NC_CLIGen 的准确率从 4% 跳到了 83%——但这更像是"忠实渲染预设内容"的能力,而非真正的内部运算。

5. 动作信息注入的深度很关键

在 GUI 模型中,论文测试了四种将用户操作注入扩散模型的方式。结论是:将动作信息融合到 Transformer 内部(internal conditioning),比在外层浅层注入(external conditioning),在交互响应的保真度上好得多。

完全神经计算机(CNC):长期愿景

论文提出了「完全神经计算机」(Completely Neural Computer,CNC)的概念,作为 NC 的成熟形态。一个 NC 要成为"完全体",需要满足四个条件:

图灵完备——能执行越来越长、越来越复杂的结构化过程,从短期控制扩展到通用计算。

普遍可编程——新能力可以被安装、组合、保留,而不仅仅是一次性触发。想象一下:你教 NC 一个新操作,它应该能记住并在之后反复使用。

行为一致——不能默默改变自己的行为,所有变化都应该通过显式的"重编程"接口来完成。就像软件需要版本管理一样,NC 也需要可审计的更新机制。

机器原生语义——NC 应该发展出自己的计算原语和编程语言,而非仅仅模仿传统计算机的组件。它的"编程语言"来自用户交互产生的 I/O 轨迹,其语法和语义是从数据中学到的,而非人类手动设计的。

这意味着什么

NC 提出的范式转变,可以从三个层面理解:

编程方式变了。 传统计算机用代码编程,NC 用演示、提示和 I/O 轨迹编程。每一次用户与数字系统的交互都在产生训练数据——这意味着 NC 的"编程语料"比人类手写代码多出好几个数量级。

表示方式变了。 传统计算机依赖离散的符号表示(变量、指针、文件系统),NC 使用连续的高维数值表示。这让它在感知、不确定性处理和近似推理方面有天然优势,但在精确符号运算上存在根本劣势。

硬件抽象变了。 传统计算机有虚拟内存、文件系统、网络协议等异构子系统,NC 中一切都是张量和张量变换。视觉、语言、控制、规划都在同一个表征空间中,可以被统一优化。

当前的局限

论文对自身局限非常坦诚:

- 符号运算不可靠——简单加减法都可能出错

- 长期稳定性不足——长时间运行后行为会漂移

- 无法复用已学会的过程——不能"安装"一个操作并在以后调用

- 缺乏更新控制——没有办法安全地修改行为而不引入副作用

- 没有运行治理机制——缺少版本控制、回滚和审计的等价物

当前的原型只证明了 I/O 对齐和短期控制的可行性。距离一个可靠、可编程、可治理的完全神经计算机,还有相当远的路。

我的思考

这篇论文最吸引我的地方在于它提出了一种真正不同的思维角度。

过去几年,整个行业的方向是让 AI 更好地"使用"计算机——更好的 Agent、更好的工具调用、更好的计算机操作。NC 的思路是反过来的:不是让 AI 学会用电脑,而是让 AI 成为电脑。

这个想法目前还非常早期,但它触及了一个深层问题:当神经网络足够强大时,计算、存储和接口之间的边界是否还需要存在?传统计算机的冯·诺依曼架构把这三者分得很清楚,因为早期硬件需要这样的模块化。但如果一个学习系统可以在连续的潜在空间中同时完成这三件事,那也许未来的"计算机"会是一种完全不同的东西。

当然,论文也清楚地展示了这条路上的巨大障碍。符号推理的缺失可能不仅仅是训练不足的问题,而是当前神经网络架构的根本局限。如何在连续表示中实现可靠的离散运算,可能需要全新的架构思路——论文也暗示了这一点,提出"机器原生"架构可能比继续堆叠现有的视频模型更有前途。

无论 NC 最终能否成为现实中的"下一代计算机",它提供了一个有价值的思考框架:也许我们不应该只问"AI 怎么更好地操作现有的软件栈",也该问一问"如果从头设计,一个由学习驱动的系统应该长什么样"。

论文信息

- 标题:Neural Computers

- 作者:Mingchen Zhuge, Changsheng Zhao, Haozhe Liu 等(Meta AI & KAUST)

- 日期:2026 年 4 月 9 日

- arXiv:2604.06425

If you read this far — thank you.

Come tell me what you thought on X.